Projekte

Technologiegerechte asymmetrische 3D-Verbindungsarchitekturen: Entwurfsstrategien- und methoden

Das Ziel dieses von der DFG geförderten Projektes ist die Entwicklung von Entwurfsstrategien und -methoden für 3D-Verbindungsarchitekturen, welche für heterogene 3D-System-on-Chips (3D-SoCs) optimiert sind. Heterogene 3D-SoCs bestehen aus mehreren gestapelten Dies, die mit unterschiedlichen Fertigungstechnologien hergestellt werden können. Dadurch ist eine Anpassung der technologischen Eigenschaften einzelner Dies an die spezifischen Anforderungen der auf den Ebenen platzierten Komponenten möglich. Bei der Erforschung von Entwurfsstrategien und Methoden verfolgen wir zwei neuartige Ansätze. Zum einen berücksichtigen wir die technologiespezifischen Eigenschaften einzelner Chip-Ebenen in heterogenen 3D-SoCs. Daher müssen existierende Verfahren für heterogene und hybride Verbindungsarchitekturen neu bewertet werden. Zum anderen erforschen wir neuartige Interaktionsmuster zwischen Komponenten, da Komponenten bis hin zur Mikroarchitekturebene räumlich verteilt werden können, um technologiespezifische Eigenschaften auszunutzen. Diese beiden Ansätze münden im Konzept der Technologie-asymmetrischen 3D-Verbindungsarchitekturen (Technology Asymmetric 3D-Interconnect Architectures, TA-3D-IAs), welche im Rahmen dieses Projektes erstmalig betrachtet werden. Im Ergebnis soll dieses Projekt zu einem besseren Verständnis der Implementierungsmöglichkeiten von TA-3D-IAs als Bestandteil heterogener 3D SoCs beitragen.

Adaptives Datenmanagement für zukünftige heterogene Hardware-/Software-Systeme

In diesem von der DFG gefördertem Projekt forscht der Lehrstuhl für Hardware-nahe Technische Informatik an Konzepten zur Integration von Co-Prozessoren wie z.B. Graphics Processing Unit oder Field Programmable Gate Arrays (FPGAs) in adaptive Datenbanksysteme. Wir entwickeln Optimierungsstrategien, die die individuellen Eigenschaften von Co-Prozessortypen und in dem Gesamtsystem inhärente Parallelität ausnutzen. Hierfür ist es notwendig, die Konzepte zur Abstraktion von Datenbankoperatoren und Co-Prozessortypen zu definieren und deren Charakteristika über geeignete Schnittstellen allen Systemebenen zur Verfügung zu stellen. Dadurch kann die Softwareebene besondere Charakteristika der (Co-)Prozessortypen und die Hardwareebene unterschiedliche Eigenschaften von Operatoren und Daten berücksichtigt. Die Verfügbarkeit dieser Charakteristika ist von hoher Relevanz für die globale Anfrageoptimierung des Datenbanksystems, um eine passende Ausführungsmethode zu wählen. Es ist außerdem nötig, den Entwurfsraum der Anfrageverarbeitung auf heterogenen Hardwarearchitekturen zu analysieren und dabei auf Parallelität in der Funktion, den Daten, und zwischen (Co-)Prozessoren zu achten. Aufgrund der dadurch hervorgerufenen Komplexität des Entwurfsraums verfolgen wir einen verteilten Ansatz, in dem die Optimierung soweit möglich an die niedrigsten Ebenen delegiert wird, da diese Informationen über die spezifischen Charakteristika haben.

Breitbandiges GPR für die Lokalisierung und Identifikation von Landminen

Landminen werden an Hand tomographischer Bilder, die breitbandige Mikrowellenbeleuchtung bis 4 GHz benötigen, lokalisiert und identifiziert. Unterschiedliche breitbandige Antennensysteme werden bezüglich ihrer lateralen Auflösung erforscht und erprobt. Signalverarbeitungsverfahren werden entwickelt, die die tiefenabhängige Auflösung optimieren und die Mehrdeutigkeit der Identifikation minimieren.

MEMS Komponenten für die breitbandige HF-Datenübertragung

Micro-Electro-Mechanical Switches (MEMS), mechanische Schalter mit Abmessungen im Mikrometerbereich, werden mit Hilfe elektrostatischer Kräfte betätigt. Wegen ihrer Größe lassen sich MEMS-Elemente mit Halbleiterbauelementen integrieren. Sie bieten einen rauscharmen Ersatz für Halbleiterschalter. Ausgewählte MEMS-Strukturen werden modelliert, hergestellt, gemessen und in HF-Schaltungen integriert. Die Modellierung umfasst geeignete HF-Ersatzschaltbilder, elektromechanische Modelle für den Betätigungsmechanismus sowie Rauschmodelle. Die MEMS-Elemente werden im Reinraum der Universität hergestellt. Die erzielten Modelle werden messtechnisch verifiziert. Abstimmbare Filter, VCOs sowie steuerbare Gruppenstrahler, die MEMS-Elemente verwenden, werden aufgebaut und gemessen.

Kapazitive und ohmsche mikroelektromechanische Schalter mit Brückenstrukturen aus Federstahl, insbesondere für Hochfrequenzanwendungen

Zielstellung des Projektes ist es, elektrostatisch betätigte kapazitive und ohmsche mikroelektromechanische Schalter (MEMS-Schalter) unter Verwendung von aus Federstahl bestehenden Brückenstrukturen zu entwerfen, herzustellen, zu optimieren und zu charakterisieren. Die beweglichen Brücken sollen dabei in monolithischer Weise durch Kathodenzerstäubung von Federstahl und in hybrider Weise durch Verbinden des Substrats mit einer strukturierten Federstahlfolie hergestellt werden. Bei beiden Ansätzen sollen die kapazitiven oder ohmschen MEMS-Brücken durch Verwendung zusätzlicher elektrisch und thermisch hoch leitfähiger Metallschichten modifiziert werden. Dabei sollen zumindest beim monolithischen Ansatz auch Schalterstrukturen betrachtet werden, bei denen die Brücke sich dreigeteilt aus Federbereich (aus Federstahl), Kontaktbereich (z.B. unter Verwendung von Silber) und aus Federbereich (aus Federstahl) zusammensetzt. Unter Verwendung dieser MEMS-Schalter sollen abstimmbare und rekonfigurierbare HF-Filter- und Antennenstrukturen realisiert werden.

EU-Horizon2020 ADAS&ME :

Adaptive leistungsfähige Fahrer-Assistenzsysteme zur Unterstützung von beanspruchten Fahrern & Effektives Abfangen von Risiken durch maßgeschneiderte Mensch-Maschine-Interaktion in der Fahrzeugautomatisierung

ADAS&ME entwickelt adaptierte leistungsfähige Fahrerassistenzsysteme, die Fahrerzustand, Situations- / Umweltkontext und adaptive Interaktion beinhalten, um automatisch die Kontrolle zwischen Fahrzeug und Fahrer zu übertragen und somit eine sicherere und effizientere Straßenbenutzung zu gewährleisten. Die Arbeit basiert auf 7 Fallstudien, die einen großen Teil der Fahrsituationen auf europäischen Straßen abdecken. Experimentelle Untersuchungen werden an Algorithmen zur Fahrerzustandsüberwachung sowie an Mensch-Maschine-Interaktions- wie auch an Automatisierungssystemen durchgeführt. Unterschiedliche Fahrerzustände wie Müdigkeit, Schläfrigkeit, Stress, Unaufmerksamkeit und beeinträchtigende Emotionen werden untersucht, wobei Sensortechnologien unter Berücksichtigung von Verkehrs- und Witterungsbedingungen eingesetzt und für individuelle Fahrer-Physiologie und Fahrverhalten personalisiert werden. Multimodale und adaptive Warn- und Interventions-Strategien basieren auf dem aktuellen Fahrerzustand und der Gefährlichkeit von Szenarien. Das Endergebnis ist ein Fahrer-Zustandsüberwachungssystem, das in die Fahrzeugautomatisierung integriert ist. Diese herausfordernde Aufgabe wird durch ein multidisziplinäres europäisches Konsortium von 30 Partnern durchgeführt, darunter ein Hersteller pro Fahrzeugtyp und 7 Direktlieferanten.

Der Lehrstuhl Kognitive Systeme an der Otto-von-Guericke-Universität trägt zu diesem Konsortium bei, indem er den emotionalen Inhalt der akustischen Äußerungen im Auto analysiert. Wir werden weiterhin in der Informationsfusion von Daten aus verschiedenen Modalitäten (akustisch, Video und andere) tätig sein, um den Verlust des Kontrollzustandes des Fahrers zu analysieren und so in mehreren Anwendungsfällen zur Fahrerassistenz beizutragen, für Autos, Busse, Lastwagen und Motorräder.

Innovationsallianz 3Dsensation im Rahmen des Programms Zwanzig20

Die Innovationsallianz 3Dsensation verleiht Maschinen durch innovative 3D-Technologien die Fähigkeit der visuellen Aufnahme und Interpretation komplexer Szenarien. Maschinen werden so zu situativ agierenden Partnern und personalisierten Assistenten des Menschen. Durch die neue Form der Mensch-Maschine-Interaktion schafft 3Dsensation den Zugang zu Lebens- und Arbeitswelten unabhängig von Alter und körperlicher Leistungsfähigkeit.

Motiviert durch den demographischen Wandel und den damit einhergehenden gesellschaftlichen Herausforderungen soll für das Bedarfsfeld "Gesundheit" im Projekt MOVA3D ein intelligenter Sensor zur häuslichen Assistenz älterer Menschen entwickelt werden. Zur vollständigen Abdeckung eines Raumes mit einem einzigen Sensor wird ein neuartiges omnidirektionales optisches 3D-Messprinzip mit einer akustischen Raumerfassung zur multimodalen Informationsgewinnung kombiniert. Hochgenaue (3D-) Video- und Audiodaten sind die Voraussetzung für die anschließende Erkennung komplexer menschlicher Handlungen in Alltagssituationen und Interaktionen mit technischen Systemen, sowie der Identifizierung von relevanten Abweichungen. Diese automatische Analyse des Verhaltens betroffener Personen bildet die Grundlage für entsprechende Assistenzfunktionen sowie eine umfangreiche Interaktion über audio- und lichtbasierte Schnittstellen. Die umfassende Einbindung der späteren Nutzer in Form von Akzeptanz-, Funktions- und Nutzerstudien ist essentieller Teil des Projektes MOVA3D. Über die Integration in aktuelle AAL- und Home-Automation-Systeme hinaus ist eine spätere bedarfsfeldübergreifende Anwendung denkbar und angestrebt.

Ziel von MOD-3D ist die Erstellung eines generischen Modells für die zeitliche Abfolge von Handlungen in

Mensch-Maschine-Interaktionen in dedizierten Anwendungen. Dies geschieht auf der Grundlage

von multimodalen 3D-Daten der direkt und indirekt geäußerten Handlungsabsichten von Nutzern.

Sonderforschungsbereich/ Transregio 62 und Nachfolgeprojet IAIS

Das interdisziplinäre Konsortium aus Informatikern, Ingenieuren, Medizinern, Neurobiologen und Psychologen befasst sich mit der systematischen Erforschung kognitiver Fähigkeiten und deren Realisierung in technischen Systemen. Dabei stehen die Eigenschaften der Individualität, Anpassungsfähigkeit, Verfügbarkeit, Kooperativität und Vertrauenswürdigkeit im Mittelpunkt der Untersuchung. Ziel ist es, diese so genannten Companion-Eigenschaften durch kognitive Prozesse in technischen Systemen zu realisieren und sie an psychologischen Verhaltensmodellen sowie anhand von Hirnmechanismen zu untersuchen. Damit sollen die Grundlagen für eine Technologie geschaffen werden, die menschlichen Nutzern eine völlig neue Dimension des Umgangs mit technischen Systemen erschließt.

Im Sonderforschungsbereich/Transregio 62 beschäftigt sich die Arbeitsgruppe um Prof. Wendemuth vor allem mit der Situationsbezogenen Erkennung anwendungsrelevanter Dispositionen und Handlungsintentionen aus gesprochener Sprache sowie der Informationsfusion zur Emotions- und Dispositionserkennung.

Intentionale, antizipatorische, interaktive Systeme (IAIS) stellen eine neue Klasse nutzerzentrierter Assistenzsysteme dar und sind ein Nukleus für die Entwicklung der Informationstechnik mit entsprechenden KMUs in Sachsen-Anhalt. IAIS nutzt aus Signaldaten abgeleitete Handlungs- und Systemintentionen sowie den affektiven Zustand des Nutzers. Mittels einer Antizipation des weiteren Handelns des Nutzers werden Lösungen interaktiv ausgehandelt. Die aktiven Rollen des Menschen und des Systems wechseln strategisch, wozu neuro- und verhaltensbiologische Modelle benötigt werden. Die im vorhandenen Systemlabor, auf Grundlage des SFB-TRR 62, applizierten Mensch-Maschine-Systeme haben dann das Ziel des Verständnisses der situierten Interaktion. Dies stärkt die regionale Wirtschaft bei der Integration von Assistenzsystemen für die Industrie 4.0 im demographischen Wandel wesentlich.

Innovationsallianz 3dSensation

Das Fachgebiet Neuro-Informationstechnik (NIT) ist mit mehreren Forschungsprojekten am millionenschweren Förderprogramm des Bundes für Ostdeutschland „ZWANZIG20 - Partnerschaft für Innovation“ beteiligt (Auswahl):

- 3D-Gesteninteraktion und Fusion von 3D-Bildern

- Kontaktfreie kamerabasierte Messung von Vitalparametern mit verbesserter Störsicherheit

- Aktive Zeilenkamerasysteme zur schnellen und hochauflösenden 3D-Vermessung großer Oberflächen

Im Rahmen der Innovationsallianz ist das Fachgebiet in aktuellen und zukünftigen Forschungsarbeiten fokussiert auf Fragestellungen der „Mensch-Maschine-Interaktion“. Die Allianz verfolgt das Ziel, die Interaktion von Mensch und Maschine grundlegend zu verändern. In einem transdisziplinären und intersektoralen Forschungsansatz wird deshalb die Entwicklung einer neuen Generation von 3D-Technologien zur Bildaufnahme, Bildverarbeitung und Visualisierung sowie Interpretation komplexer Szenarien in Echtzeit vorangetrieben. Unter anderem soll die Sicherheit des Menschen in Fertigungsprozessen steigen, die Mobilität in urbanen und ländlichen Räumen unabhängiger von gesundheitlichen und altersbedingten Beeinträchtigungen werden und sich die Möglichkeiten zur Gesundheitsversorgung durch Identifikation von Auffälligkeiten und Gefahren verbessern. Integriert werden Forschungsarbeiten in den Kognitions- und Neurowissenschaften, Sozial- und Arbeitswissenschaften sowie Informationswissenschaften.

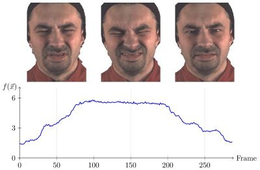

Automatische Schmerzerkennung basierend auf Gesichtsausdruck und psychobiologischen Parametern

Die Beurteilung von akuten Schmerzen ist eine der grundlegenden Aufgaben in Krankenhäusern. Bis heute ist es üblich, sich auf die Äußerung des Patienten zu verlassen. Für psychisch Betroffene ist dies nur wenig zuverlässig. Für bestimmte Menschen oder Neugeborene kann es überhaupt nicht verwendet werden. Es gibt jedoch verschiedene Merkmale, die auf Schmerzen hindeuten. Dazu gehören spezifische Veränderungen im Gesichtsausdruck und in psychischobiologischen Parametern wie Herzfrequenz, Hautleitfähigkeit oder elektrische Aktivität der Skelettmuskulatur.

Wir arbeiten an einem automatischen System, das erkennen kann, ob ein Patient Schmerzen empfindet oder nicht, und die Intensität des Schmerzes beurteilen kann. Basierend auf Erfahrungen in der Mimikerkennung kann unser System die Mimik des Schmerzes von anderen unterscheiden und die Intensität des Ausdrucks bewerten. In der aktuellen umfassenden Studie untersuchen wir die Beziehungen zwischen Schmerz, Mimik und psychobiologischem Feedback. Darüber hinaus stehen die Daten der Studie, die BioVid Heat Pain Database genannt wird, der wissenschaftlichen Gemeinschaft zur Verfügung. Im Projekt arbeiten wir mit dem Emotion Lab der Universität Ulm zusammen.